Overcoming catastrophic forgetting in neural networks

http://www.pnas.org/content/early/2017/03/13/1611835114.abstract

Enabling Continual Learning in Neural Networks | DeepMind

https://deepmind.com/blog/enabling-continual-learning-in-neural-networks/

ディープラーニングは言語の翻訳、画像分類、画像生成などさまざまなタスクを処理するための最も成功した機械学習技術として知られています。

しかし、ディープニューラルネットワークでは、大量のデータが一度に入力される場合にのみタスクを処理できるように設計されており、ネットワークが特定のタスクを処理するときに、各種パラメーターは、そのタスクのために最適化されます。

このため、新しいタスクが導入されると、ニューラルネットワークがそれまでに獲得した知識は上書きされるという特徴があり、これは「catastrophic forgetting(破滅的忘却、致命的な忘却)」と呼ばれ、ニューラルネットワークの限界の一つと考えられています。

ニューラルネットワークの構造上の限界に対して、人間の脳は段階的に学び、スキルを一つずつ身につけ、新しい課題の解決のためにそれまでの知識を応用することができるという特長があります。

このような「過去のスキルを記憶して新しい課題の解決に応用できる」という人間やほ乳類が持つ学習の特長からインスピレーションを得たDeepMindは、課題解決を記憶して後の課題解決に応用できるニューラルネットワークのアルゴリズム「Elastic Weight Consolidation(EWC)」を開発しました。

EWCでは、タスクを解決するたびに、そのデータがどれくらい重要なのかをスコア化します。そして、その重要度を示すスコアに比例して記憶が上書きから保護される仕組みが採用されています。

つまり、重要でないデータはこれまでのニューラルネットワークと同じように上書きすることで消去されますが、重要なタスクではデータが保護されるため、以前、学習した内容を上書きしたり、大きな計算コストをあらためて割くことなく、新しいタスクを学習できるとのこと。

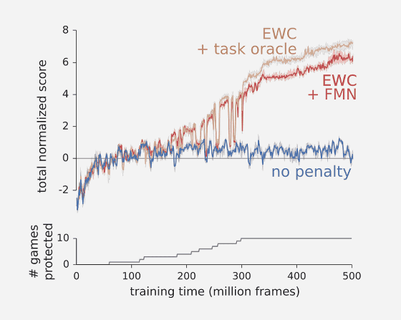

DeepMindはEWCの有効性をテストするために、Atariのゲームを使って実験しています。個々のゲームをスコアだけから学習することはそれ自体が難しい作業ですが、複数のゲームを連続して学習することは、各ゲームごとに個別の戦略が求められるため、さらに難度は上がります。

EWCを使わない通常のニューラルネットワークでは、青色のグラフのように、一つのゲームが終わると致命的な忘却によってデータが上書きされスコアが上昇しないのに対して、EWCを有効化すると、簡単に忘れることなく、次々とゲームが変わる中でも学習することができたとDeepMindは述べています。

(グラフ)

現在のコンピューターはデータに応じた対応ができずリアルタイムで学習することはできませんが、DeepMindによると今回の研究によって、ニューラルネットワークにおける致命的な忘却は回避できることが示されたとのこと。

この研究は、より柔軟に効率的に学習できるプログラム開発への第一歩を踏み出したことを象徴するものだとDeepMindは述べています。

http://gigazine.net/news/20170315-elastic-weight-consolidation/

- 3:名無しさん@1周年2017/03/15(水) 18:51:36.25 ID:FMqcdj6S0.net

- もうわけわかめ

- 5:名無しさん@1周年2017/03/15(水) 18:53:17.50 ID:9ZypkyY/0.net

-

> ニューラルネットワークの構造上の限界に対して、人間の脳は段階的に学び、スキルを一つずつ身につけ、新しい課題の解決のためにそれまでの知識を応用することができるという特長があります。

結局、一番の失敗要因は人間でしたという結論はガチ

特に私服を肥やす政治家と官僚。 - 15:名無しさん@1周年2017/03/15(水) 18:59:29.08 ID:PUdH4tB00.net

- >>5

人工知能が破滅するのは、誰かが 欲望 を組み込んだ時だと確信してるわ。 - 48:名無しさん@1周年2017/03/15(水) 19:14:30.39 ID:icWby9Bs0.net

- >>5

私服? - 68:名無しさん@1周年2017/03/15(水) 19:27:44.91 ID:+0Ov9M/B0.net

- >>5

> 特に私服を肥やす政治家と官僚。

それは人間というより、システムの問題

さらに言えば、現実を無視した政治制度と必要以上に法体系に依存する社会構造と、

経済における不必要な介入と政官財癒着の問題 - 7:名無しさん@1周年2017/03/15(水) 18:56:36.24 ID:AiawU9Jf0.net

-

>EWCでは、タスクを解決するたびに、そのデータがどれくらい重要なのかをスコア化します。

>そして、その重要度を示すスコアに比例して記憶が上書きから保護される仕組みが採用されています。

ここがなんか汎用性あるかどうか怪しい - 11:名無しさん@1周年2017/03/15(水) 18:57:56.64 ID:VYhOoVP80.net

- >>7

場当たり的すぎるよね。

学習がまともに収束するかどうかすら怪しい。 - 17:名無しさん@1周年2017/03/15(水) 19:00:06.51 ID:Q7HK5uRo0.net

- >>11

結果からのフィードバックはもちろんある前提なんじゃないか? - 8:名無しさん@1周年2017/03/15(水) 18:57:04.69 ID:XjzxlOPI0.net

- 人類滅亡の12のリスクの内、11を解決してくれるかな

- 9:名無しさん@1周年2017/03/15(水) 18:57:07.01 ID:nZCVtnH50.net

-

さっぱり意味分からん。

アルゴリズムとC言語の違いを30文字で教えてくれ。 - 20:名無しさん@1周年2017/03/15(水) 19:00:47.37 ID:AiawU9Jf0.net

- >>9

printf("ハロー"); → 「printf()」がC言語の命令

アルゴリズムは問題を解くための手順 - 13:名無しさん@1周年2017/03/15(水) 18:59:18.46 ID:7Y5wk5ro0.net

- 馬鹿から教えられると、馬鹿になるんだよな。リセットではなく保存しないと

- 16:名無しさん@1周年2017/03/15(水) 18:59:37.24 ID:93zJc1ha0.net

-

・

タスク、処理するために ビックデータでニューラルネットの重みつけしたら、もうそのビックデータ、

次から次へと どんどん捨てていかないと システムがパンクするからなぁ。

だから そのタスク専用のものだけってことだろ。

それを 中間段階のデータを 残しておいて DBに蓄積しておけば 他のタスクでも流用できる。みたいなぁ。 - 18:名無しさん@1周年2017/03/15(水) 19:00:22.77 ID:vWWb1eRD0.net

-

結果としては

「似ている」の範囲が大きくなるだけじゃないの? - 19:名無しさん@1周年2017/03/15(水) 19:00:41.91 ID:hM2Pl2bu0.net

-

なるほど、つまりあなたは人類は滅亡すると

そうおっしゃりたいのですね・・・? - 23:名無しさん@1周年2017/03/15(水) 19:03:53.43 ID:WJspGn3F0.net

- >>19

恐らく、無い

AIと人間の関係は、人間と海老のような関係になる

大抵は無関係。一部は恩恵を享受し続けるか、破滅的な打撃を受ける物が一部いるかもしれないって程度 - 56:名無しさん@1周年2017/03/15(水) 19:19:33.92 ID:pvp/gxUy0.net

- >>23

それも違うな

人間と機械は別のものではなくなる

人間の体、脳すら機会と接続することで人間と機械・AIの境目はだんだん曖昧になる

同時にネットの発達もまた脳の接続とともに進んで、個人の境目も機械と人間と同じく曖昧になるだろう - 21:名無しさん@1周年2017/03/15(水) 19:02:41.16 ID:+umCuGVr0.net

-

人は記憶型と思考型に大別できる

説明しよう

容量制限、AIに与えられてる記憶媒体の容量の上限に達してしまったときにどうするかということ

重要度の低いものから削除して容量を空けるようにしたんだとさ - 43:名無しさん@1周年2017/03/15(水) 19:12:36.80 ID:+umCuGVr0.net

- >>21の続き、訂正か・・・

容量制限ではなく重複項目において上書きするかどうかの判断か・・・・ - 25:名無しさん@1周年2017/03/15(水) 19:04:46.53 ID:WJspGn3F0.net

- >>21

違う

容量は無限にある - 28:名無しさん@1周年2017/03/15(水) 19:05:41.89 ID:+umCuGVr0.net

- >>25

では何? - 39:名無しさん@1周年2017/03/15(水) 19:10:14.69 ID:WJspGn3F0.net

- >>28

そのままだよ

忘却を回避しながら学習するってアルゴリズムなだけ

容量は関係ない - 51:名無しさん@1周年2017/03/15(水) 19:15:45.02 ID:+umCuGVr0.net

- >>39

俺が間違ってた

皆様方、大変ご迷惑をお掛けしました

/⌒Y⌒ヽ

/ / ̄ ̄~\

/// \

/ |::. |

/ ∧:::. /\

(  ̄ ̄⌒\/⌒ ̄ ̄)

̄ ̄ ̄ヽ」」人LLノ ̄ ̄ - 30:名無しさん@1周年2017/03/15(水) 19:07:21.78 ID:oEU6+/6j0.net

- DQNも立派になった

- 44:名無しさん@1周年2017/03/15(水) 19:12:55.93 ID:vke8xxRU0.net

- >>30

俺もそこまで読んだ - 31:名無しさん@1周年2017/03/15(水) 19:07:31.54 ID:1FD7oGYV0.net

-

無からAを学習させる→最強のAを学習

無からBを学習させる→最強のBを学習

最強のAからBを学習させる→最強より劣化したAと劣化B状態になる。

これを繰り返しC,D,E,Fと沢山学習する

→凡庸で最強のかけらもなくなる(FA - 32:名無しさん@1周年2017/03/15(水) 19:07:42.44 ID:haAUz3aR0.net

- ヤルッツェブラッキン!

- 58:名無しさん@1周年2017/03/15(水) 19:20:19.84 ID:2xGJ4w7j0.net

- >>32

新造人間キャシャーン - 40:名無しさん@1周年2017/03/15(水) 19:11:23.11 ID:/OCjaI6/0.net

-

AIを突き詰めると人間になっていくのは面白い

人間を超えると神になるのだろうか - 45:名無しさん@1周年2017/03/15(水) 19:13:09.66 ID:1FD7oGYV0.net

- >>40

>AIを突き詰めると人間になっていくのは面白い

それ×

AIを突き詰めると凡人になっていくのは面白い

これ○ - 46:名無しさん@1周年2017/03/15(水) 19:13:39.15 ID:WJspGn3F0.net

- >>40

人間から見れば神かもしれないね

神になったAIは更にスゴイ神2を作り出し、神2は更に神3を作る

神2、神3…は人間から見ればどれも同じ神なのだろう - 54:名無しさん@1周年2017/03/15(水) 19:17:14.23 ID:4ZoYmAsv0.net

- 人間の脳は、記憶も二ユーロネットワークで構成されていてストレージではない

- 55:名無しさん@1周年2017/03/15(水) 19:18:49.75 ID:WJspGn3F0.net

-

昔は人間に似せる事が目標とされていた

10年ぐらい前から人間の脳を真似る必要なくね?と言われ出した

と思ったらまた人間の脳の模倣しだして…

面白いなぁ - 60:名無しさん@1周年2017/03/15(水) 19:21:20.86 ID:S4O1Vbs90.net

-

元からあるもの以外で育てることの出来るモノをようやく人は造ったんだけど、

コンピュータの未来が想像できない、一体どんな姿になるのかわからない - 71:名無しさん@1周年2017/03/15(水) 19:28:13.43 ID:J4gsqbNB0.net

-

人間がAIを設計してる間は、さほど期待も心配もしない。

AIがAIを設計するときが来たら、人の期待も心配もどうでも良くなる。 - 91:名無しさん@1周年2017/03/15(水) 19:47:23.05 ID:WJspGn3F0.net

- >>71

心配しろよ、そろそろ始まってるぞ

今まで学習結果は人間が判断してチューンナップしていたが、それもAIに任せるようになった - 75:名無しさん@1周年2017/03/15(水) 19:30:04.89 ID:4z/mdecU0.net

- >>71

アルファ碁はルールすら自分で見つけ出してAI同士の対局を超高速で繰り返して経験値を積んだらしい - 79:名無しさん@1周年2017/03/15(水) 19:36:46.95 ID:ni5PvkQZ0.net

- >>75

もともと制限されたルールの範囲の中で法則を見つけるのは、コンピュータが得意とするところなんよ

デモンストレーションとしては面白いが、deep blueほどの衝撃はなかった - 78:名無しさん@1周年2017/03/15(水) 19:35:53.89 ID:J4gsqbNB0.net

- >>75

それとは違う。

アルファ碁はあくまで人の設計。

学習の内容は人が理解できなくとも、学習の仕組みは理解できてる。

AIがAIを設計したら、もうどんなメカニズムかも知ることができない。 - 85:名無しさん@1周年2017/03/15(水) 19:43:12.58 ID:OI2mPSct0.net

- >>78

今人が理解できなきゃダメって規制する方向で検討しとります

そこがdeep learningはめんどくさい - 89:名無しさん@1周年2017/03/15(水) 19:46:03.89 ID:J4gsqbNB0.net

- >>85

>今人が理解できなきゃダメって規制する

それは人為的すぎるので、タガは外れると思う。

AIは人の理解とは無関係に、つまり自律的に進化するだろう。 - 99:名無しさん@1周年2017/03/15(水) 19:50:51.34 ID:OI2mPSct0.net

- >>89

ベースのAIフレームワークを作るのはどうしても人間なので・・

まず人間が違反しないとタガは外したくても外れない

もちろんミスの可能性はあるけど、そんなの旧来のシステムも一緒

リスクが高ければ高いほど二重三重の安全装置をつけるのは変わらないから、AIだからって例外ではないよ - 108:名無しさん@1周年2017/03/15(水) 19:55:59.41 ID:J4gsqbNB0.net

- >>99

人間自身はなぜ進化したのかと言えば、それは進化論的な淘汰によるものだろう。

だから、フレームワークの作成を進化にゆだねれば、もう人間の手から離れてしまう。 - 117:名無しさん@1周年2017/03/15(水) 19:58:26.54 ID:+0Ov9M/B0.net

- >>108

> だから、フレームワークの作成を進化にゆだねれば、もう人間の手から離れてしまう。

そのフレームワークは人間が作っている

更にAIは人工物による処理なので、人間とは異なる

結局、AIに人間と同じことをやらせるには、ハードウェアとしての人間が必要になる

そしてそれはAIではない - 119:名無しさん@1周年2017/03/15(水) 19:58:57.73 ID:OI2mPSct0.net

- >>108

そう。だから委ねちゃダメっていう規制になる

AIに権限を与えなければ、決してベースのフレームワークは書き換えられない

っていうか、規制しなくてもそんな何が起こるか分からんもん実用で使えないがね - 127:名無しさん@1周年2017/03/15(水) 20:02:43.29 ID:+0Ov9M/B0.net

- >>119

というより、必ず人間の意思が入る

一番の問題は、「AI自身が意思を持っている」と勘違いすることで、

これがカルト教を意味する

つまり、「この像が涙を流した。生きています」を信じる人が騙されるというところ

人間の体験をそのまま人間と同じ情報にするには、人間とそっくりのハードウェアが必要になり、

それは人間でなければならないという物理的な制約条件をクリア出来ない以上、

AIが持つ意思というものには意味はなく、情報工学の世界では「バグ」として扱われてしまう - 138:名無しさん@1周年2017/03/15(水) 20:09:51.86 ID:J4gsqbNB0.net

- >>127

「意志」なんて人間に固有とか深遠なものではない。

すぺては進化論的な過程で生成されたもの。つまり「自己の存続」が最大の価値。

というか、それを「価値」としたものが存続しているだけ。

AIを進化論的な文脈に参加させれば、それなりに進化していゆく。

そして今の人類が進化のただ一つの答えなんかではない。限りない答えがあり得る。 - 148:名無しさん@1周年2017/03/15(水) 20:12:47.94 ID:ZXzyndLm0.net

- >>138

> 「意志」なんて人間に固有とか深遠なものではない。

> すぺては進化論的な過程で生成されたもの。つまり「自己の存続」が最大の価値。

> というか、それを「価値」としたものが存続しているだけ。

全然違う

前提が間違っている

自己の存続と価値は同じではない

> AIを進化論的な文脈に参加させれば、それなりに進化していゆく。

進化するという話と人間の意思と同じになるという話は別だ

前者は可能だが、後者はAIとは関係ない

人間の脳が進化の過程で生まれてきたことと、

人間の脳が自己の存続だけで活動しているはずだという固定観念には、

何の関連性もない、単なる空想の類でしかない - 88:名無しさん@1周年2017/03/15(水) 19:45:57.78 ID:D1KPKesv0.net

-

>>1

全部おぼえたらいいやん - 90:名無しさん@1周年2017/03/15(水) 19:47:16.75 ID:MQWEpx3Q0.net

- なら、新商品開発会議の1シートに人工知能を座らせ、円卓会議にしてみれば良い。 データの開陳はできても、円卓の人間のようなアイディアが出せるかどうか。

- 104:名無しさん@1周年2017/03/15(水) 19:54:19.50 ID:G2ZPSCvn0.net

- >>90

あ、それは簡単だぜ?一番偉い人の発言にイエスだけ言ってればOKだから。

おそらくファミコンで事足りる。 - 94:名無しさん@1周年2017/03/15(水) 19:48:43.50 ID:QLCxUMRe0.net

- 人間はスマホに指示される通りに動く靴になる って現実になりそう

- 107:名無しさん@1周年2017/03/15(水) 19:55:34.19 ID:+vMRT/sn0.net

- そろそろ三目並べをやらせないとまずいぞ

- 130:名無しさん@1周年2017/03/15(水) 20:04:06.85 ID:5Qi4cCmJ0.net

- 始まってしまったか.....

- 150:名無しさん@1周年2017/03/15(水) 20:13:38.90 ID:bbcv052w0.net

-

そしてCon-Humanが反逆を起こしてオペレーションレイフォースが発動するんだな

胸が熱いな - 151:名無しさん@1周年2017/03/15(水) 20:14:01.90 ID:MQWEpx3Q0.net

-

人工知能間でエラー検出がうまく機能するかだな。 自己増殖が完成したとしてだが。

できなければ、暴走マシン以外の何ものでもない。 逆に、何もできないデッドロックに入ってもガラクタだ。

人工知能の欠点「破滅的忘却」を回避するアルゴリズムが開発される…人間の様に「過去のスキルを記憶→新課題の解決へ応用」が可能に

引用元:http://ai.2ch.sc/test/read.cgi/newsplus/1489571411

引用元:http://ai.2ch.sc/test/read.cgi/newsplus/1489571411

![NEW GAME! Lv.6 [Blu-ray]](https://images-fe.ssl-images-amazon.com/images/I/51TY6DOsTCL._SX250_.jpg)

![[2CS] サントリー 天然水(南アルプス) (2L×6本)×2箱](http://ecx.images-amazon.com/images/I/51hh8R1Q0YL._SX250_.jpg)